Que un modelo de IA se atasque jugando a algo tan básico como ‘Pokémon’ parece preocupante. No lo es en absoluto

Era 2013 y casi nadie había oído hablar de DeepMind, una pequeña startup de inteligencia artificial. A sus investigadores se les ocurrió hacer que su sistema de IA aprendiera a jugar (y a ganar) videojuegos, y la entrenaron con algunos títulos de la vieja consola Atari.

Entre ellos estaba ‘Breakout’ (en España apareció como ‘Arkanoid’), y un vídeo de la época muestra como tras 10 minutos jugando la máquina no se enteraba de apenas nada. Tras dos horas de juego, eso sí, ya jugaba como un experto.

Pero a las cuatro horas pasó algo alucinante: la máquina descubrió un «truco» para maximizar el esfuerzo: hacía que la pelota acabase creando «un túnel» y luego colaba la pelota por ese túnel para que no parara de rebotar y de ir acabándose casi todo el nivel sin esfuerzo.

Desde entonces usar videojuegos para entrenar modelos de IA o para comprobar si son capaces de adaptarse a ellos y completarlos es algo habitual en la industria. Precisamente es lo que intentó Anthropic cuando hace unas semanas lanzó Claude 3.7 Sonnet.

Este modelo híbrido de IA ha demostrado ser un avance notable en ámbitos como la programación y el razonamiento, pero en Anthropic quisieron ponerlo a prueba con un test singular: que jugase al videojuego ‘Pokémon’.

La IA se atasca

En este experimento los responsables de Anthropic querían evaluar si los sistemas de IA «pueden afrontar retos con competencias cada vez más complejas, no ya únicamente a través del entrenamiento, sino del razonamiento generalizado».

Las versiones anteriores de Claude lo pasaban mal incluso tratando de comenzar a jugar desde la pantalla de inicio del videojuego, pero el «pensamiento ampliado» de Claude 3.7 Sonnet permite que el nuevo modelo «planifique con antelación, recuerde sus objetivos y se adapte cuando fallan las estrategias iniciales» de una forma que sus predecesores no hacían.

Para los responsables de Anthropic estas mejoras acabarán ayudando a resolver problemas del mundo real. Es algo que también estamos viendo con el benchmark ARC-AGI 2, que precisamente está dirigido a medir la capacidad de las IAs de hacer cosas que a nosotros nos resultan fáciles (controlar un videojuego, resolver un puzzle visual) pero a estos modelos les resultan especialmente difíciles.

Fuente: Anthropic.

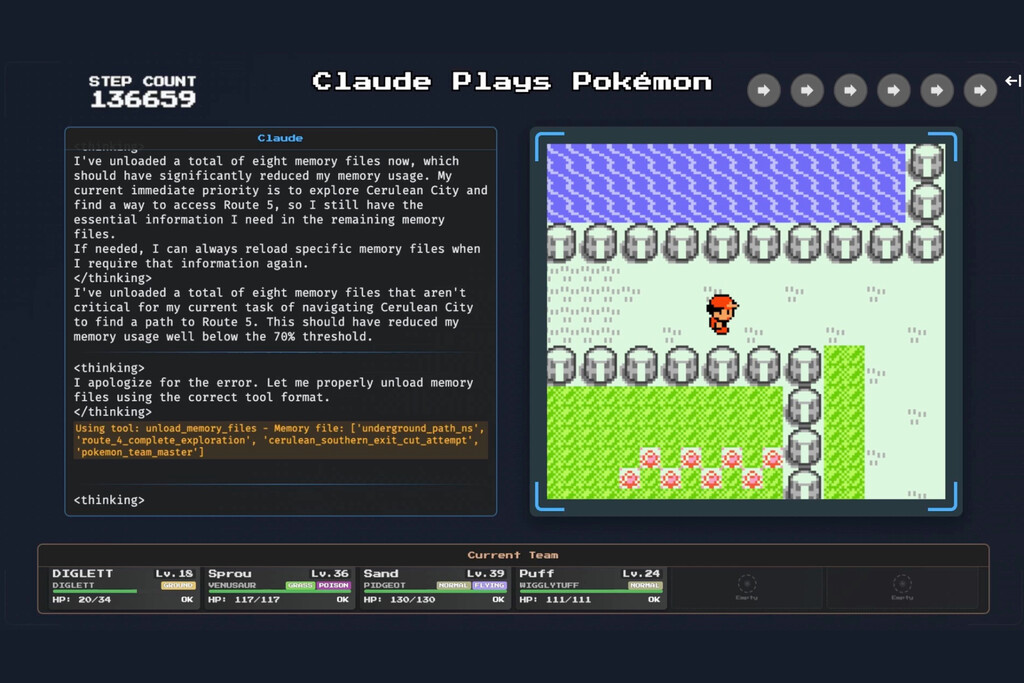

El avance de Anthropic aquí es destacable, pero está lejos de poder ser considerado como un éxito. De hecho y como comentan en Ars Technica, miles de espectadores han comprobado en el canal de Twitch creado por Anthropic cómo Claude se quedaba totalmente atascado en el Monte Sélénite, una de las secciones del videojuego.

En ese canal se puede ver además cómo efectivamente Claude sigue intentando resolver el problema y avanzar. «Piensa» y «razona» y hasta muestra qué está «pensando» y «razonando», pero el modelo sigue sin acabar de superar esa fase del videojuego.

Y a pesar de todo, este es un gran logro de la IA

Teniendo en cuenta que el videojuego está orientado a niños, parece fácil despreciar el logro de Anthropic, pero hay que valorar estos avances de forma muy positiva. Para empezar, el modelo de Claude 3.7 utilizado para jugar no estaba «preentrenado» para jugar al videojuego: tenía que aprender sobre la marcha y adaptarse al juego.

Aquí además Claude «ve» la pantalla y lo que ocurre para reaccionar en base a ese análisis. Y el problema es que los gráficos de ‘Pokémon’ son muy básicos y pixelados, lo que plantea un reto aún mayor para el modelo de Anthropic: con gráficos mejores probablemente se comportaría mucho mejor, explicaba uno de los responsables del experimento.

Aun así Claude se comporta especialmente bien en las partes del juego en las que se muestra texto, algo que permite a este modelo de IA reconocer mejor lo que necesita hacer en esa fase del videojuego.

Pero si hay un problema grave, ese también es el de la memorización. Claude tiene problemas para recordar todo lo que ha aprendido: tiene una «memoria» limitada de 200.000 tokens y cuando estos se agotan Claude recurre a hacer resúmenes y condensar la información, lo que puede llevar a eliminar pequeños detalles que son importantes para avanzar en el juego.

Sea como fuere, el logro de Anthropic sigue siendo destacable, y apunta a un futuro en el que estos modelos podrán jugar de forma autónoma y hacerlo además de forma excepcional a todo tipo de juegos. Como DeepMind ya lo hizo con aquella simplona versión del ‘Arkanoid’, pero a lo grande.

En Xataka | Lo último de Google es una IA que juega a videojuegos. La clave: lo hace entendiendo el lenguaje natural

–

La noticia

Que un modelo de IA se atasque jugando a algo tan básico como ‘Pokémon’ parece preocupante. No lo es en absoluto

fue publicada originalmente en

Xataka

por

Javier Pastor

.

– ¡Hola! Soy Nicolás Jiménez Silva, un apasionado por el mundo digital, el cine, el streaming, la tecnología y la ciencia. En este blog, exploro mis intereses, comparto mis opiniones y descubrimientos, y me sumerjo en las últimas tendencias. ¡Espero que disfrutes de la lectura!

Publicar comentario